注意力机制是什么意思

时间:2025-06-13 09:36 阅读数:1019人阅读

*** 次数:1999998 已用完,请联系开发者***

1、注意力机制是什么意思?

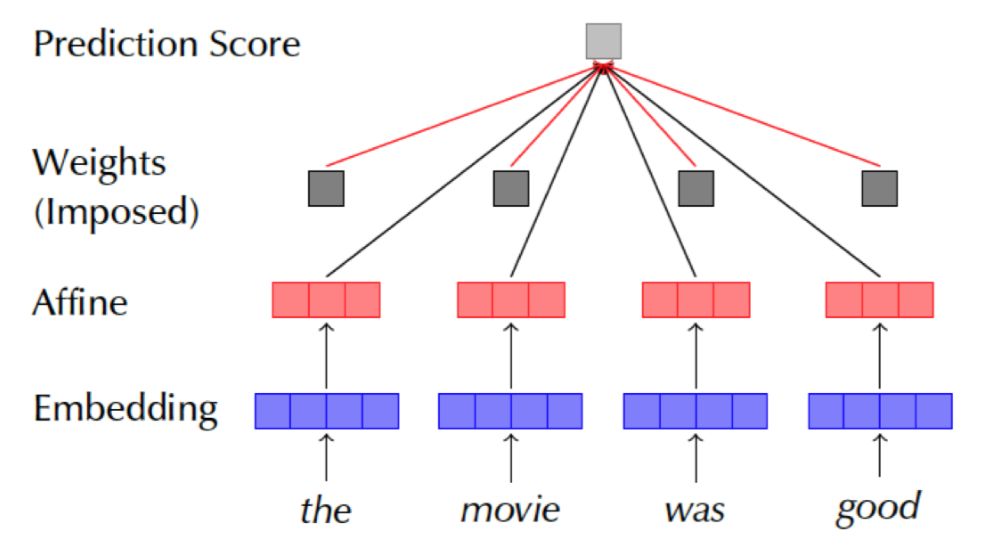

一文明白什么是自注意力机制,还不快来学自注意力机制的一个关键优势是其并行化能力。不像传统的循环神经网络(RNN)那样需要顺序处理序列,自注意力允许模型在处理序列时并行计算所有位置的注意力分数,这显著提高了计算效率。 自注意力机制是Transformer模型的核心组成部分,它在自然语言处理(NLP)任务中取得了巨大...

2、注意力机制是啥

3、注意力机制通俗理解

特斯拉确认已优化 FSD 系统司机注意力监控机制,减少不必要提醒IT之家 5 月 20 日消息,特斯拉已确认,其 FSD 系统备受司机注意力监控机制已经得到优化。此前不少车主反映该功能过于频繁地提醒驾驶员注意力不集中,给驾驶体验带来了不必要的干扰。据IT之家了解,特斯拉的 FSD(Supervised)允许驾驶员在车辆行驶过程中无需将双手置于方向盘上,但...

4、注意力机制的作用是什么

5、注意力机制有哪几种

MiniMax挑战Transformer架构,要做AI agent时代的新基建?业内称没有...第一次大规模实现线性注意力机制,直接挑战传统的Transformer架构,再一次在行业掀起巨浪。某大模型领域专家对记者解释,“传统的Transfor... 到什么时候。”最近的案例是李开复的零一万物,李开复公开表态,只有大厂能烧超大的模型,“我们觉得要和一个烧得起大模型的大厂合作,以后...

6、注意力机制概述

≡(▔﹏▔)≡

飞飞加速器部分文章、数据、图片来自互联网,一切版权均归源网站或源作者所有。

如果侵犯了你的权益请来信告知删除。邮箱:xxxxxxx@qq.com

上一篇:注意力机制是什么意思

下一篇:注意力机制是什么