注意力机制是什么时候提出来的

*** 次数:1999998 已用完,请联系开发者***

(#`′)凸 DeepSeek发布NSA AI模型:原生稀疏注意力机制实现降本增效与长...出来就成了行业焦点。 NSA机制最牛的地方在于两个创新点:动态分层稀疏策略和硬件对齐设计。以前的全注意力模型,计算量会随着输入文本长度的平方增长,处理长文本简直是灾难。NSA就不一样了,它把粗粒度的Token压缩和细粒度的Token选择结合起来,模型在看全局内容的时候能...

DeepSeek在下一代人工智能模型中首次引入“稀疏注意力”机制并解释说该平台引入一种名为DeepSeek Sparse Attention的“稀疏注意力机制”,该公司还暗示正在与芯片制造商合作开发该模型。今年早些时候,DeepSeek的R1模型以其精妙的算法震惊硅谷,如今该公司正致力于开发新产品。最新版本在V3.1的基础上,引入旨在探索和优化人工智能训...

∩﹏∩

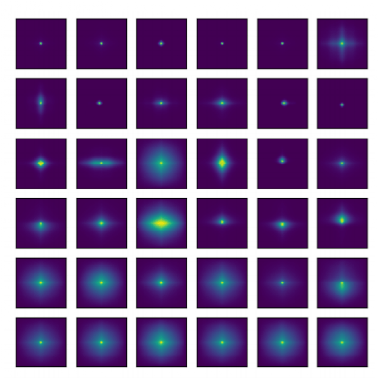

北大团队升级DeepSeek注意力:速度快四倍且精度不丢北大团队最近搞出个大新闻——他们发明了一种叫HISA的新稀疏注意力机制,直接把DeepSeek大模型的速度提了2到4倍,关键是精度还几乎没... 下游的注意力计算模块根本不用改。短文本的时候它会自动退化成原来的方法,只有超长文本才触发分层筛选,全程自适应,简直不要太智能。 实...

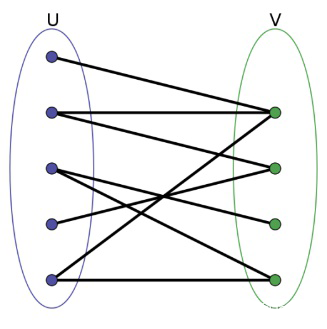

北大团队改造DeepSeek注意力,速度快四倍还不丢精度他们提出了HISA(分层索引稀疏注意力),核心思路也很简单:既然挨个打分太费时间,那就先按块筛掉大部分无关内容,再在剩下的小块里精细选。在功能逻辑上实现对原有模块的等价替换,无需修改后续注意力计算逻辑,相当于 “换了个更高效的筛子,筛出来的东西几乎没变”。具体就两步,...

╯0╰

马斯克5天2次点赞!国产AI凭什么征服全球大佬?这款AI到底藏着什么黑科技? 故事要从一篇让学术界沸腾的论文说起。Kimi团队研发的“注意力残差”机制,彻底颠覆了传统AI的信息处理方式。打个比方,原来的模型像老旧水管输水,层数越多水压越弱,而新机制就像装了智能筛选器,能精准过滤无效信息。这项技术让480亿参数的大模型...

∪△∪ 蚂蚁百灵开卷模型性价比!长文本推理只要1/10成本,6.1B激活撬动40B...引入了混合线性注意力(Linear Attention)机制,专为长文本、低成本推理等场景提效而设计。 眼下,大模型开始真正走进应用场景,推理成本却成了... 不仅节省重前向计算时间,还提升了训练效率与最终回报。 ▲对比使用rollout probs与 raining probs 进行PPO clip训练的效果。左图为训练奖励...

+▂+

飞飞加速器部分文章、数据、图片来自互联网,一切版权均归源网站或源作者所有。

如果侵犯了你的权益请来信告知删除。邮箱:xxxxxxx@qq.com

上一篇:注意力机制是什么时候提出来的

下一篇:安卓海外加速器永久免费