注意力机制和transformer的关系

>▽< *** 次数:1999998 已用完,请联系开发者***

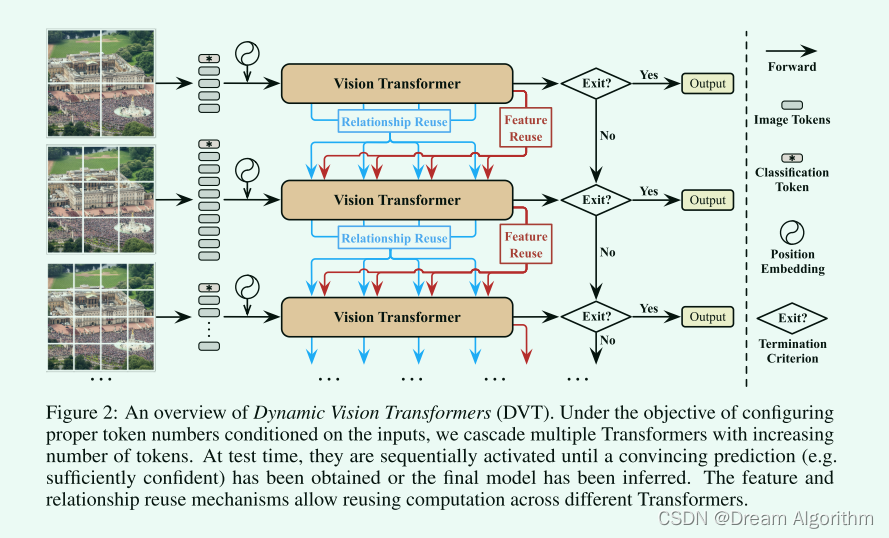

>0< 长序列中Transformer高级注意力机制探究而且较长的序列更易包含不相关或关联性较弱的信息,进而引入噪声,这同样会进一步分散注意力机制,使其难以聚焦于输入的关键部分。 所以,本文着重深入探究长序列中所应用的高级注意力机制的数学复杂性与理论基础,这些机制能够高效应对Transformer模型中长序列所引发的计算与认...

谷歌新架构融合Transformer与RNN,降低显存门槛解锁超长上下文现在的大模型基本都是用Transformer架构做的,它能成为主流,主要是因为记忆力能跟着上下文长度增长——注意力机制的计算量和空间占用会随文本长度呈二次方增加。这让Transformer特别擅长从长文本里找信息,但也正因为这种二次方复杂度,导致算力和显存消耗特别大,处理超长文本...

●▽●

(`▽′) 蚂蚁灵波开源实时3D重建!LingBot-Map采用几何上下文Transformer架构,通过创新的GCA注意力机制高效整合跨帧信息,在OxfordSpires等权威数据集上刷新多项纪录:绝对轨迹误差仅6.42米,较此前最优方法提升2.8倍;ETH3D基准重建F1分数达85.70,精度提升超8%。更关键的是,它能以20FPS速度连续处理10万+...

ˇ^ˇ

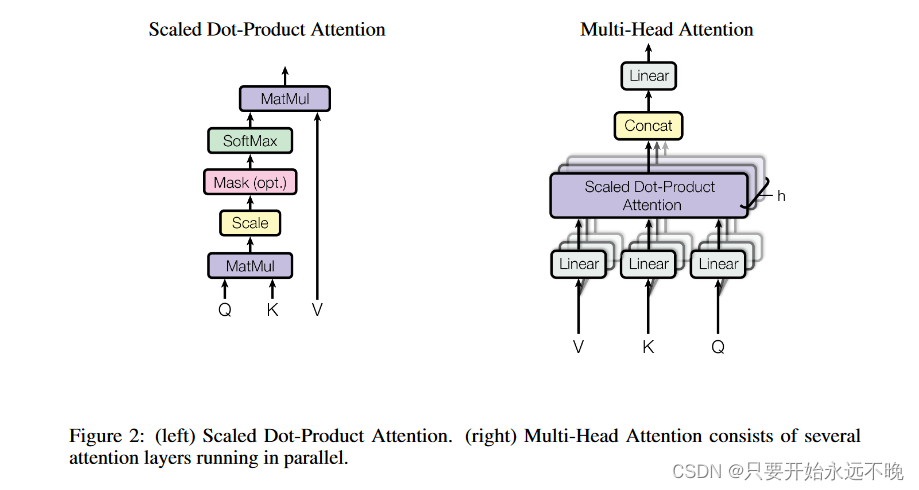

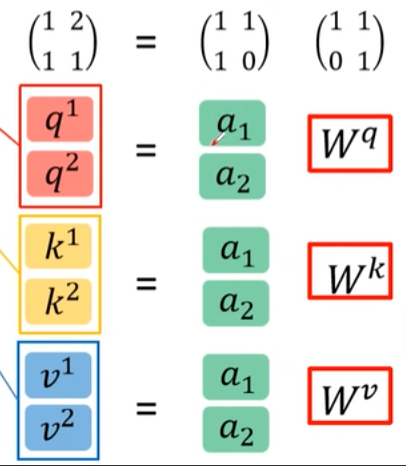

藏不住了!Transformer的3大超能力曝光,颠覆AI革命性技术Transformer横空出世,带来“并行处理”的革命性理念,不再逐字阅读,而是一次性“浏览”整句话或整篇文档,同步捕捉语句关联。这一转变从根本上解决了训练效率问题,为GPT、BERT等复杂语言大模型的诞生奠定了基础。超能力解密Transformer的核心能力源于“注意力机制”,类似人...

Block Transformer架构解析在基于transformer的自回归语言模型(LMs)里,生成令牌的成本颇高。这是由于自注意力机制需要关注所有先前的令牌,一般通过在自回归解码过... 块解码器:块解码器对整个块序列应用自注意力,以模拟全局依赖关系。 令牌解码器:令牌解码器在每个块内应用自注意力,处理细粒度的局部依赖...

≥△≤

Kimi开源新线性注意力架构,首次超越全注意力模型,推理加速6倍用一种全新的注意力机制,在相同训练条件下首次超越了全注意力模型。在长上下文任务中,它不仅减少了75%的KV缓存需求,还实现了高达6倍的推理加速。有网友表示期待:这个架构下的Kimi K2.5何时来?不过,咱还是先来看一下Kimi Linear是如何挑战传统Transformer的。让注意力真正...

英伟达推出Nemotron 3 Super企业AI智能体新模型英伟达最近放出了一款大招——Nemotron 3 Super,这可是专门为企业打造的AI智能体模型。它最厉害的地方在于把Mamba序列建模、Transformer注意力机制和专家混合路由技术揉到了一块儿,目标很明确,就是让企业系统处理复杂任务和实现自动化的能力更上一层楼。想象一下,以后企...

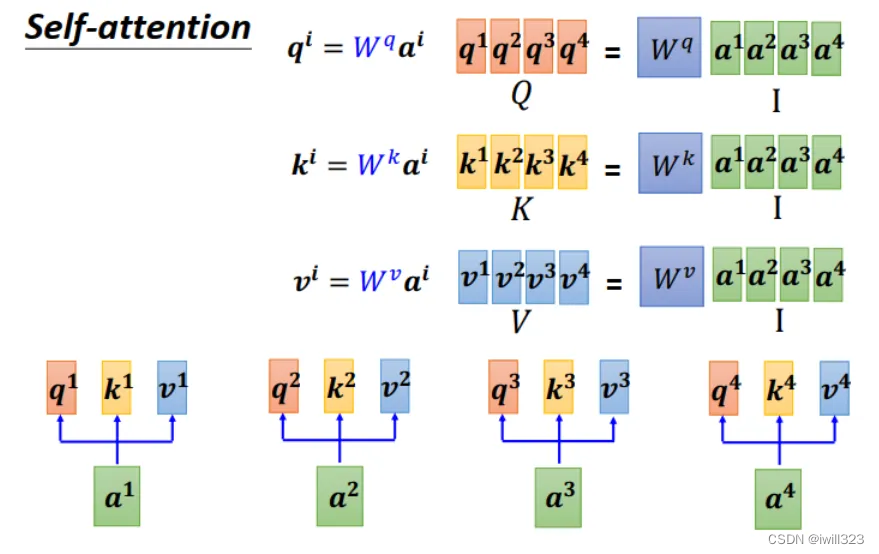

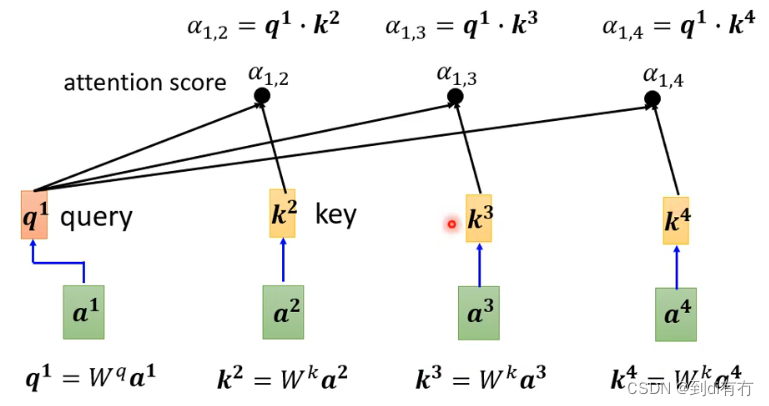

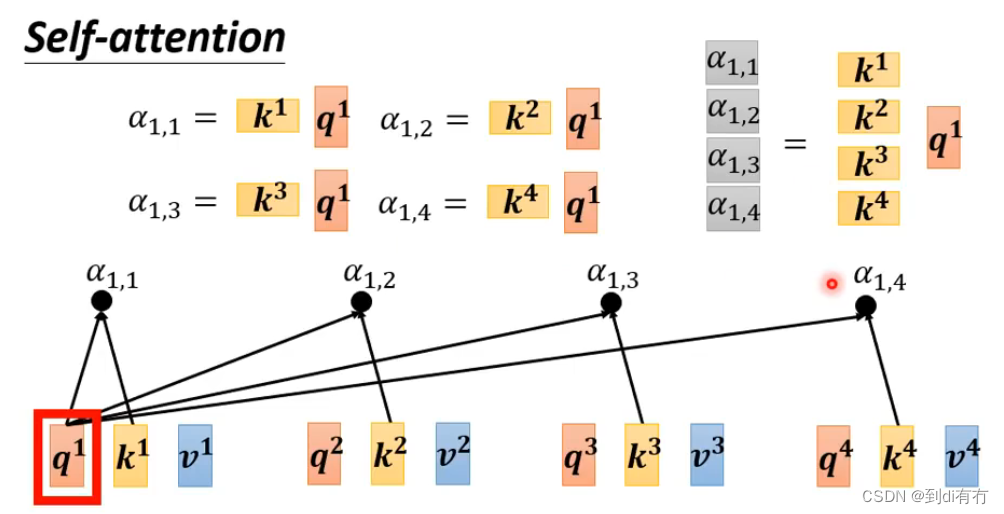

ChatGPT背后那个”幽灵”,到底是什么Transformer 的方式,是把这本书摊开放在你面前,让你同时看到所有页面,然后回答问题。哪种方式更容易理解书的整体结构和远距离联系?答案不言而喻。但随之而来的问题是:同时出现的这些词,怎么知道彼此之间谁和谁更相关?这就是自注意力机制(Self-Attention)要解决的事。自注意力...

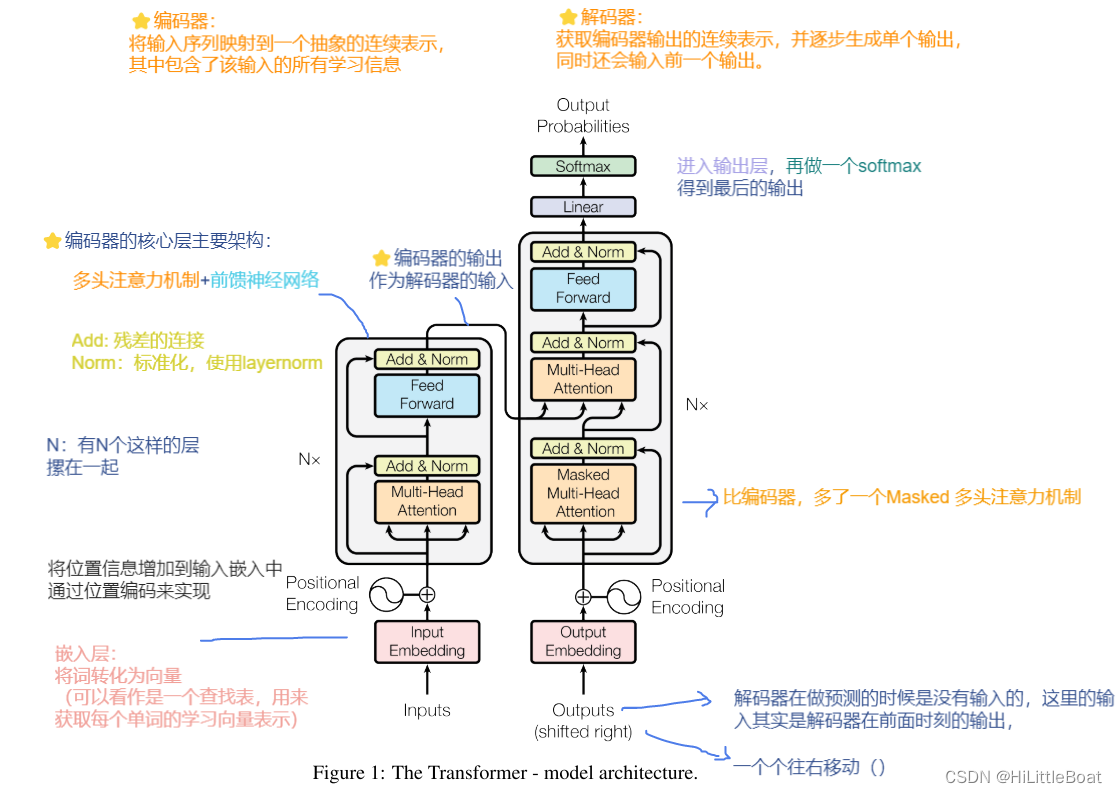

从零学习大模型(5)——位置编码:让 AI 读懂 “语序” 的关键技术在 Transformer 架构中,有一个容易被忽略却至关重要的模块 —— 位置编码(Positional Encoding,PE)。如果说注意力机制让模型能 “理解关联”,前馈神经网络让模型能 “提纯特征”,那么位置编码的作用就是让模型能 “感知顺序”。人类语言中,语序直接决定语义:“我打了你” 和 “你...

9B端侧开源模型实现百万上下文,面壁SALA混合架构成关键最近大模型圈又有新突破!面壁智能搞出了个叫SALA的混合注意力架构,把9B的端侧模型直接推到了百万上下文级别。这可不是小打小闹,要知道传统Transformer的全注意力机制一直有个老大难问题——计算量随文本长度平方增长,显存占用更是吓人,想处理超长文本简直是天方夜谭。现...

飞飞加速器部分文章、数据、图片来自互联网,一切版权均归源网站或源作者所有。

如果侵犯了你的权益请来信告知删除。邮箱:xxxxxxx@qq.com