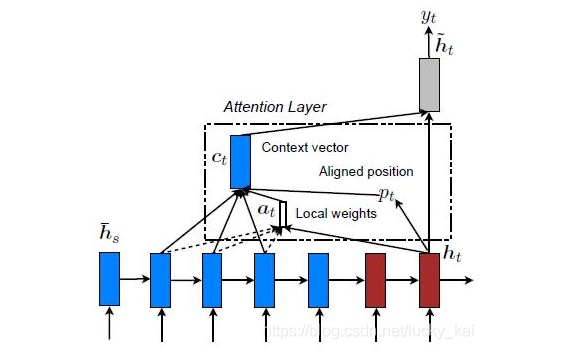

注意力机制如何计算

?△? *** 次数:1999998 已用完,请联系开发者***

南洋理工大学突破线性注意力机制:无误差计算让AI记忆永不衰减计算负担,就好比让一个图书管理员同时记住图书馆里每本书的位置和内容关系一样困难。传统的AI注意力机制就像一个需要不断查看所有书籍... 决定如何重新组织书架。重要的书籍会促使管理员快速清理相关区域的旧书籍,为新书腾出最佳位置;而不太重要的书籍则只会引起小范围的调...

DeepSeek发布NSA AI模型:原生稀疏注意力机制实现降本增效与长...2025年2月18日,中国深度探索公司(DeepSeek)在人工智能领域放出大招——推出原生稀疏注意力(Native Sparse Attention,简称NSA)机制。这个技术专门解决传统AI模型处理长文本时计算量大、成本高的老问题,通过算法创新和硬件适配优化,让长文本训练和推理速度飞涨,同时还能保持...

●▂●

DeepSeek-V4震撼发布作者:麻辣“龙虾”话事人4月24日,全新系列模型DeepSeek-V4预览版正式官宣上线并同步开源。此次发布包含Pro和Flash两个版本,均标配百万字(1M)超长上下文能力,通过全新注意力机制与DSA稀疏注意力技术,大幅降低计算和显存需求,实现开源领域领先水平。性能方面,V4-Pro在Ag...

提升LLM注意力机制效率的方法探索为提高LLM中注意力机制的效率,主要有两种努力方向:优化单设备的计算与存储能力,像FlashAttention;以及运用多设备的分布式系统,如RingAttention。 FlashAttention通过利用静态随机存储器(SRAM)来储存中间状态,而非依赖高带宽存储器(HBM),以此提升注意力计算速度。 RingAttentio...

⊙0⊙

天准科技获得发明专利授权:“基于因果关系和注意力机制的目标跟踪...专利名为“基于因果关系和注意力机制的目标跟踪方法”,专利申请号为CN202411385757.7,授权日为2025年6月17日。专利摘要:本发明提供了一种基于因果关系和注意力机制的目标跟踪方法,方案利用特征提取子网络获取目标特征,根据上一时刻的目标跟踪结果计算轨迹特征并构建行...

˙0˙ 中信证券:国产算力黄金发展期到来 关注三条投资主线智通财经APP获悉,中信证券发布研报称,DeepSeek-V4预览版发布,其参数量相对上一代提升一倍,性能比肩全球闭源模型,达到开源模型SOTA,算力成本继续优化,高性价比百万上下文模型普惠时代到来。DeepSeek-V4在混合注意力机制、mHC、Muon等核心方向创新升级,计算网络比、...

o(?""?o

谷歌新架构融合Transformer与RNN,降低显存门槛解锁超长上下文现在的大模型基本都是用Transformer架构做的,它能成为主流,主要是因为记忆力能跟着上下文长度增长——注意力机制的计算量和空间占用会随文本长度呈二次方增加。这让Transformer特别擅长从长文本里找信息,但也正因为这种二次方复杂度,导致算力和显存消耗特别大,处理超长文本...

阿里、Kimi、蚂蚁集体押注,混合注意力成大模型必答题?这款万亿参数模型采用1:7混合注意力比例,在能力接近Claude Opus 4.6的同时,API定价仅为其五分之一。事实上,国内大模型头部厂商已形成效率优化的技术共识,混合注意力架构探索正从可选项变成必答题。 传统Softmax注意力机制虽然能精准捕捉词间关联,但计算量会随文本长度呈平...

DeepSeek-V3.2正式版发布,性能比肩GPT-5,人工智能ETF(159819)与...事件:12月1日晚DeepSeek发布V3.2正式版与V3.2-Speciale,推理能力在行业中处于领先位置。能力方面,在推理类Benchmark中,V3.2已达到GPT-5的水平,V3.2-Speciale则在IMO与CMO等竞赛中均斩获了金牌级成绩。机制方面,模型采用稀疏注意力机制降低计算复杂度,使得长上下文任务...

∪﹏∪ 清华开源 TurboDiffusion:AI 视频生成最高提速 200 倍采用了 SageAttention 和 SLA(稀疏线性注意力机制)来加速注意力计算,显著降低了模型处理高分辨率视频时的算力开销。其次,团队引入了 rCM(时间步蒸馏)技术,有效减少了扩散模型的采样步数。这些技术方案的深度融合,让模型在保持生成效果一致性的基础上,大幅削减了计算延迟。G...

飞飞加速器部分文章、数据、图片来自互联网,一切版权均归源网站或源作者所有。

如果侵犯了你的权益请来信告知删除。邮箱:xxxxxxx@qq.com