注意力机制深度解析

*** 次数:1999998 已用完,请联系开发者***

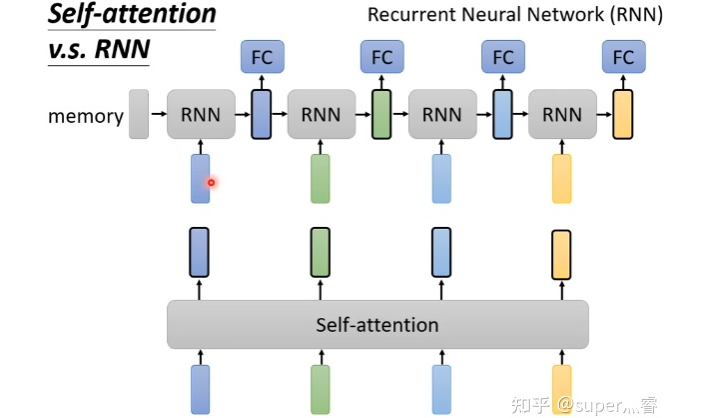

DeepSeek-AI突破:NSA注意力机制提速训练11倍稀疏注意力的前世今生传统的AI注意力机制就像一个极度认真的学生,面对任何文本都要逐字逐句地仔细分析。当处理一段包含64000个词的长... 与现有方法的深度比较NSA与现有稀疏注意力方法的对比就像比较不同类型的交通工具。H2O方法就像一辆只能在高速公路上快速行驶的汽车...

⊙▂⊙ 复旦大学破解长文本AI的"注意力盲点"问题,让处理效率提升5倍在人工智能快速发展的今天,大型语言模型处理长文本的能力变得越来越重要。从理解数小时的视频内容到分析整个代码库,这些应用都需要AI能够高效处理超长的文本序列。然而,传统的注意力机制在处理长文本时面临着严重的效率瓶颈。这项由复旦大学、上海创新研究院、字节跳动和...

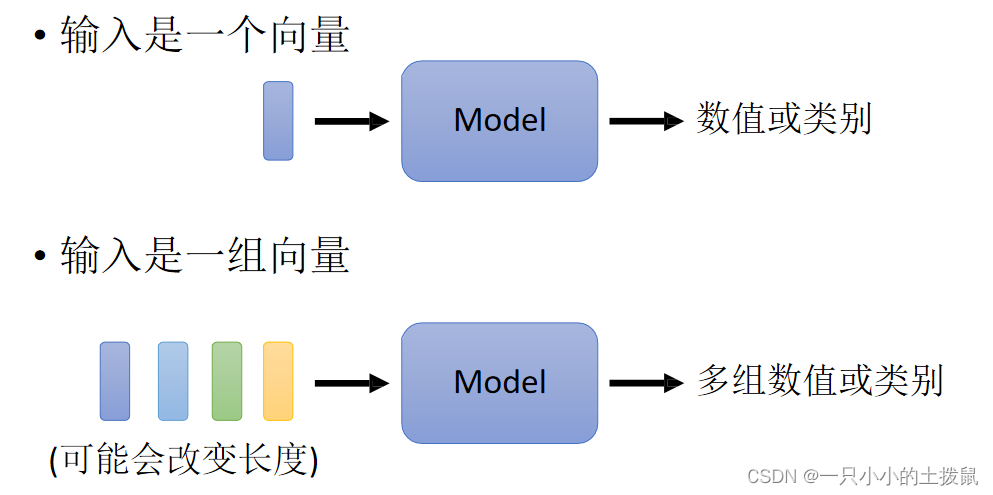

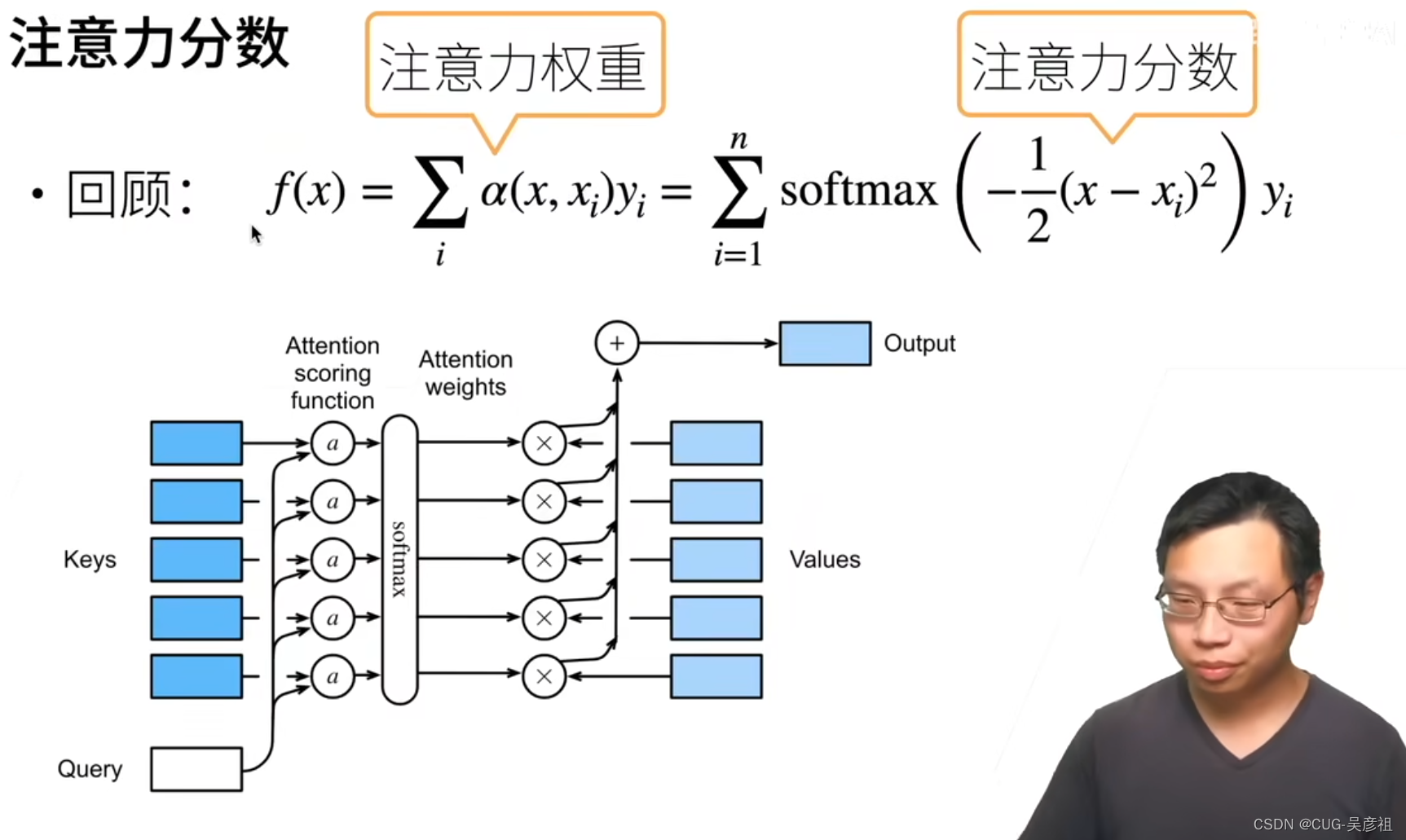

为什么 AI 无所不能,却连洗车该开车还是走路都搞不懂?大语言模型时而如神明般无所不能,时而像呆萌的'大聪明'犯下低级错误。本文深度解析LLM底层Transformer架构的三大核心环节,揭秘AI为何不会数数、为何在简单问题上翻车,以及如何通过理解Tokenization机制和注意力原理,真正掌握驯服AI的'黑盒密码'。它像无所不能的神,也像一本正...

+^+

大脑内在时钟揭秘:科学家发现认知功能300毫秒节律循环记忆和注意力机制的理解。 这项基于五项大型脑磁图研究的分析揭示,大脑并非随机激活各种功能网络,而是遵循着一个高度有序的时间序列。就如同交响乐团中每个乐器都有其演奏的精确时机,大脑的不同区域也在这个内在节拍器的指挥下协调工作,确保注意力、记忆处理、感觉输入和...

●﹏● Block Transformer架构解析在基于transformer的自回归语言模型(LMs)里,生成令牌的成本颇高。这是由于自注意力机制需要关注所有先前的令牌,一般通过在自回归解码过... 下面我们详细分析参数分配比例和块长度: a) 困惑度在不同分配比例中呈现U型模式 在上图(a)中展示了三种模型大小的五个不同比例的训练损...

蚂蚁万亿开源模型Ling-2.5-1T:情商与执行双突破它用了混合线性注意力机制,也就是Ring-flash-linear-2.0技术,再加上工程优化,推理效率直接提升40%,KV缓存也压缩到了行业领先水平。别看它... 不管是文献综述还是合同分析,细节都能抓得死死的。 在Agent执行力这块,Ling-2.5-1T也没让人失望。它有Agent-based校验机制和思维链压缩...

飞飞加速器部分文章、数据、图片来自互联网,一切版权均归源网站或源作者所有。

如果侵犯了你的权益请来信告知删除。邮箱:xxxxxxx@qq.com

上一篇:注意力机制深度解析

下一篇:注意力机制深度学习模型