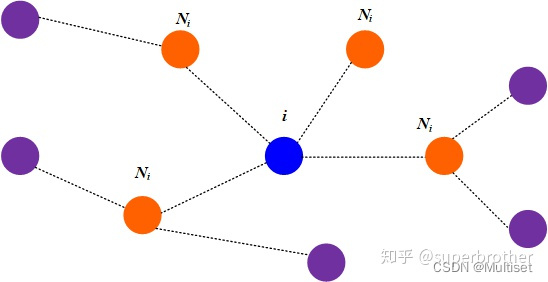

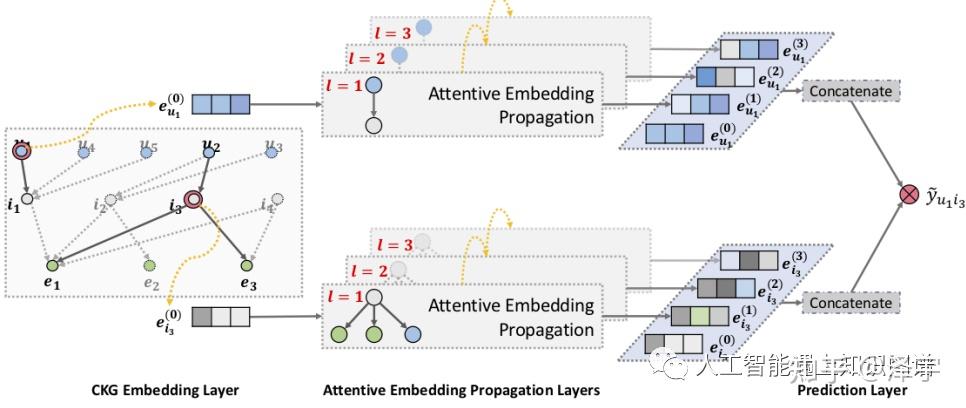

注意力机制图神经网络

*** 次数:1999998 已用完,请联系开发者***

饮食中的添加剂与多动症有关联吗?图片来源于网络 一、关联机制:添加剂如何影响儿童神经行为? 1. 干扰神经递质平衡,加剧兴奋 - 抑制失衡 部分人工色素可能抑制抑制性神经递质GABA合成,其代谢产物影响多巴胺受体合成;人工甜味剂代谢产物影响血清素合成,导致情绪和注意力问题。 2. 引发肠道 - 大脑轴紊乱,间接影响...

中国电信获得发明专利授权:“基于注意力机制的小尺寸人头检测方法...专利名为“基于注意力机制的小尺寸人头检测方法及相关设备”,专利申请号为CN202211609796.1,授权日为2026年2月3日。专利摘要:本公开提供了一种基于注意力机制的小尺寸人头检测方法及相关设备,涉及计算机图像领域。该方法包括,将目标图像输入预先训练好的第一神经网络,输...

大模型训练大纲两种模型架构设计架构1-TransformerTransformer核心3要素:自注意力机制、位置编码、前馈神经网络(FNN)输入部分:源文本【嵌入层】及其【位置编码器】目标文本【嵌入层】及其【位置编码器】编码器(Encoder)由N个编码器层堆叠而成每个编码器层由两个子层连接结构组成第一个...

>△<

从零学习大模型(5)——位置编码:让 AI 读懂 “语序” 的关键技术在 Transformer 架构中,有一个容易被忽略却至关重要的模块 —— 位置编码(Positional Encoding,PE)。如果说注意力机制让模型能 “理解关联”,前馈神经网络让模型能 “提纯特征”,那么位置编码的作用就是让模型能 “感知顺序”。人类语言中,语序直接决定语义:“我打了你” 和 “你...

ˋ^ˊ

大脑内在时钟揭秘:科学家发现认知功能300毫秒节律循环牛津大学研究团队在《自然神经科学》杂志发表的突破性研究显示,大脑通过一个持续300到1000毫秒的重复循环来组织不同的认知功能,这一发现可能彻底改变我们对意识、记忆和注意力机制的理解。 这项基于五项大型脑磁图研究的分析揭示,大脑并非随机激活各种功能网络,而是遵循...

飞飞加速器部分文章、数据、图片来自互联网,一切版权均归源网站或源作者所有。

如果侵犯了你的权益请来信告知删除。邮箱:xxxxxxx@qq.com

上一篇:注意力机制图神经网络

下一篇:free门安卓版