什么是上下文缓存_什么是上下文缓存

*** 次数:1999998 已用完,请联系开发者***

阿里云百炼宣布部分模型上下文缓存降价8月26日,阿里云大模型服务平台百炼发布部分模型上下文缓存降价通知,本次调价后,当请求部分模型命中缓存时,命中的输入Token将按cached_token计费,单价从调价前input_token单价的40%调整到input_token单价的20%;未被命中的输入Token按标准input_token计费。

≥△≤ 不用额外缓存!英伟达开源记忆压缩方案,128K上下文提速2.7倍关键在于上下文压缩。通过实时学习将关键内容压缩到自身权重中,让模型在测试阶段依然保持学习状态。这样既避免了额外缓存的负担,又能精准捕捉长文本中的核心逻辑。给模型装上记忆压缩包TTT-E2E并没有依赖复杂特殊架构,反而是基于带滑动窗口注意力的标准Transformer,容易...

升腾生态硬核赋能!上交大攻克超长上下文推理难题,性能大幅跃升基于vLLM-Ascend 推理框架研发出一套针对超长上下文推理的稀疏注意力 KV Cache 分层缓存管理系统。在升腾 AI 软硬件平台的全方位赋能下,该项目成功破解单卡支持超长上下文推理的显存与性能双重难题,同时大幅提升吞吐量。 项目核心创新在于设计了 KV Cache 分级缓存集成机...

ˋωˊ

⊙﹏⊙‖∣° 全球首个“龙虾”模型来了!GLM-5-Turbo发布上下文长度 200K。同时,这款模型还具备思考模式、流输出、函数调用、上下文缓存和 MCP 等特性,确保多步任务能够获得更高稳定性和可靠性,让 OpenClaw 能够快速从对话过渡到执行。此外,这款模型还能够更好地处理高数据吞吐量和长逻辑链 Lobster 任务,进一步提升执行效率和响...

谷歌新算法引发美股存储板块集体下挫专门解决AI系统中键值缓存(KV缓存)随上下文窗口扩大形成的核心内存瓶颈。该技术无需对模型进行重新训练或微调,即可将KV缓存压缩至3bit精度,同时基本不影响模型准确率。测试数据显示,TurboQuant对Gemma、Mistral等开源模型可实现约6倍的KV缓存内存压缩效果,在英伟达H10...

>﹏<

内存焦虑有救了!谷歌发布新型AI内存压缩技术将大语言模型缓存内存占用至少缩减6倍,推理速度最高提升8倍。AI模型运行时有一种“工作内存”,即KV缓存(Key-Value Cache)。每当模型处理信息、生成回答时,KV缓存便会迅速膨胀,且上下文窗口越长,缓存占用的内存越大。这已成为制约AI系统效率与成本的核心瓶颈,并非模型不够...

谷歌推出压缩算法TurboQuant,宣称实现约6倍内存节省3月26日,谷歌推出一种可能降低人工智能系统内存需求的压缩算法TurboQuant。TurboQuant压缩技术旨在降低大语言模型和向量搜索引擎的内存占用。该算法主要针对AI系统中用于存储高频访问信息的键值缓存(key-value cache)瓶颈问题。随着上下文窗口变大,这些缓存正成为主要的内...

ˋ﹏ˊ

谷歌TurboQuant算法问世 实现AI内存需求6倍压缩谷歌最近放出了一个大招——新推出的TurboQuant压缩算法,据说能让人工智能系统的内存需求直接砍到原来的六分之一。这技术专门解决AI模型里那个叫“键值缓存”的内存瓶颈问题。你想啊,现在AI处理的文本越来越长,上下文窗口一扩大,这些缓存就跟堵在路上的车似的,死死占着内...

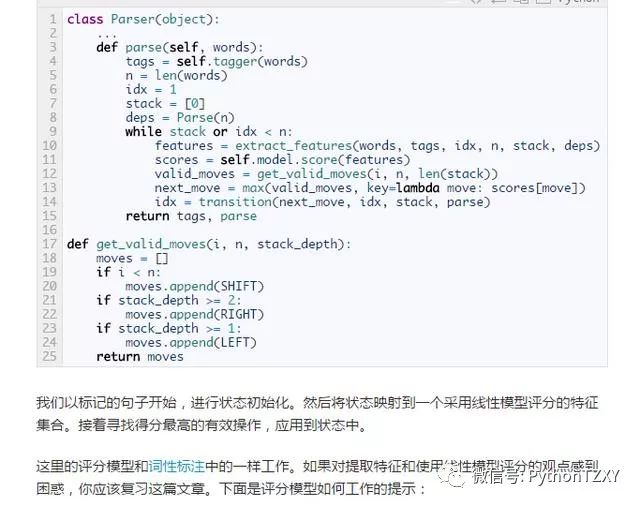

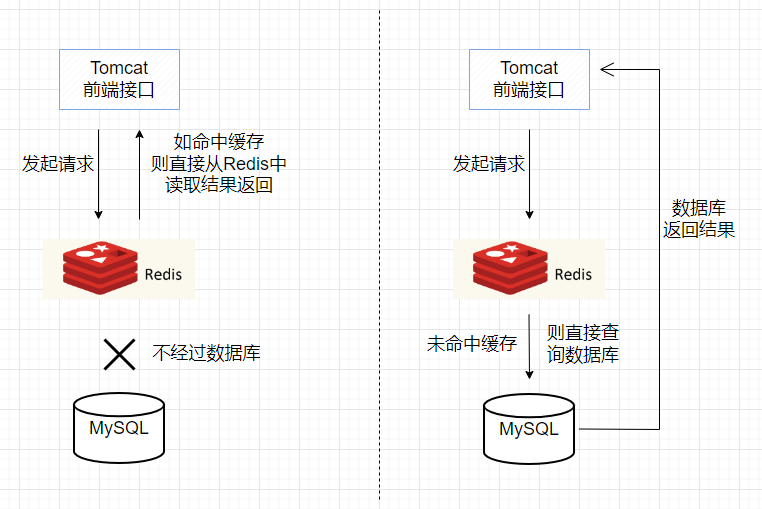

华为AI推理新技术犀利! 中国银联大模型效率提高了125倍其融合了多类型缓存加速算法工具,分级管理推理过程中产生的KV Cache记忆数据,扩大推理上下文窗口,以实现高吞吐、低时延的推理体验,降... UCM是什么对于上述颇多术语的介绍,我们来拆解一下。首先,什么是KV Cache?据了解,KV Cache是一种用于优化Transformer等模型推理速度...

华为发布AI推理创新技术UCM:三级存储架构提升推理效率8月12日,华为数据存储产品线总裁周跃峰博士在2025金融AI推理应用落地与发展论坛上发布了AI推理创新技术UCM(推理记忆数据管理器)。该技术以优化KV Cache管理为中心,融合多类型缓存加速算法工具,分级管理推理过程中产生的KV Cache记忆数据,扩大推理上下文窗口,实现高吞吐...

飞飞加速器部分文章、数据、图片来自互联网,一切版权均归源网站或源作者所有。

如果侵犯了你的权益请来信告知删除。邮箱:xxxxxxx@qq.com