注意力机制最简单解释

*** 次数:1999998 已用完,请联系开发者***

5G NSA非独立组网及稀疏注意力机制应用5G NSA(非独立组网)是早期部署的一种架构,简单说就是让5G和4G“搭伙干活”。它采用双连接方式,把5G NR的控制面锚定在4G LTE上,核心... NSA这个缩写最近又有了新含义。2025年2月,DeepSeek推出了一种叫NSA的稀疏注意力机制,专门用于超快速的长上下文训练和推理。这东西...

DeepSeek在下一代人工智能模型中首次引入“稀疏注意力”机制DeepSeek周一更新了一个实验性的人工智能模型,并称之为迈向新一代架构的中间步骤。DeekSeek在Hugging Face上发布帖子,概述了DeepSeek-V3.1-Exp平台,并解释说该平台引入一种名为DeepSeek Sparse Attention的“稀疏注意力机制”,该公司还暗示正在与芯片制造商合作开发该...

≥△≤

∩△∩ FBK研究院:语音模型的"注意力"机制并非你想的那样可靠首次系统性地揭示了语音转文字模型中交叉注意力机制的真实解释能力。想象你正在听一个朋友讲话,你的大脑会自动把注意力集中在重要的声音片段上,然后将这些声音转化为文字理解。在人工智能的语音转文字系统中,有一个叫做"交叉注意力"的机制被认为扮演着类似的角色——它应...

ˇ▂ˇ

DeepSeek V4报告详尽公开:484天换代之路全解析最有意思的是DeepSeek和Kimi搞起了「技术互哺」。Kimi K2复用了DeepSeek V3首创的MLA注意力机制,转头DeepSeek V4就用上了Kimi验证过的Muon二阶优化器,把用了十年的AdamW给换掉了。这种底层技术共享直接打破了行业壁垒,结果就是两家的开源万亿参数模型——DeepS...

∪﹏∪

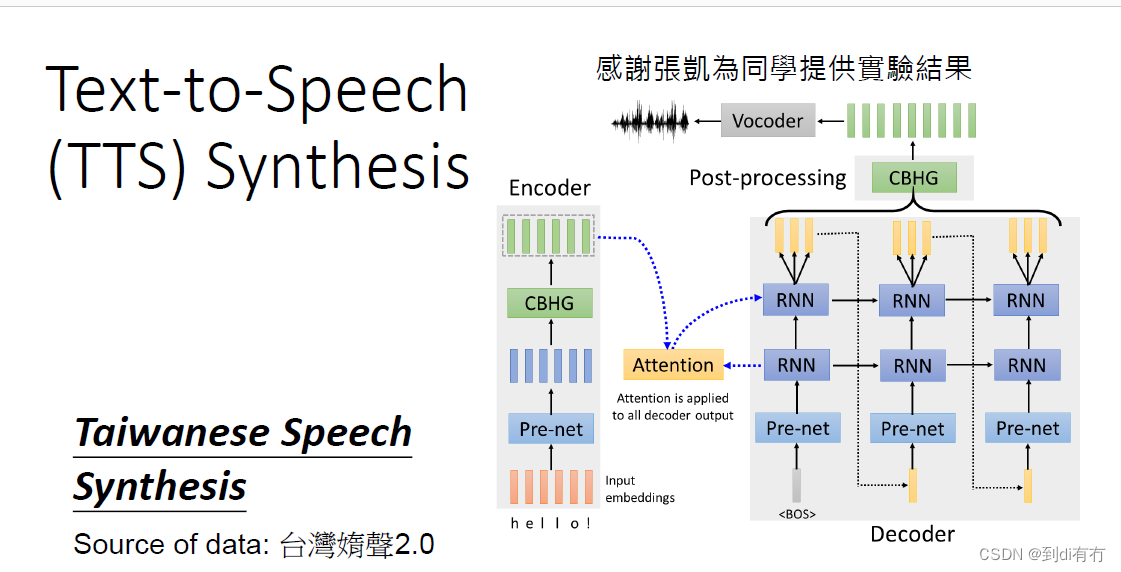

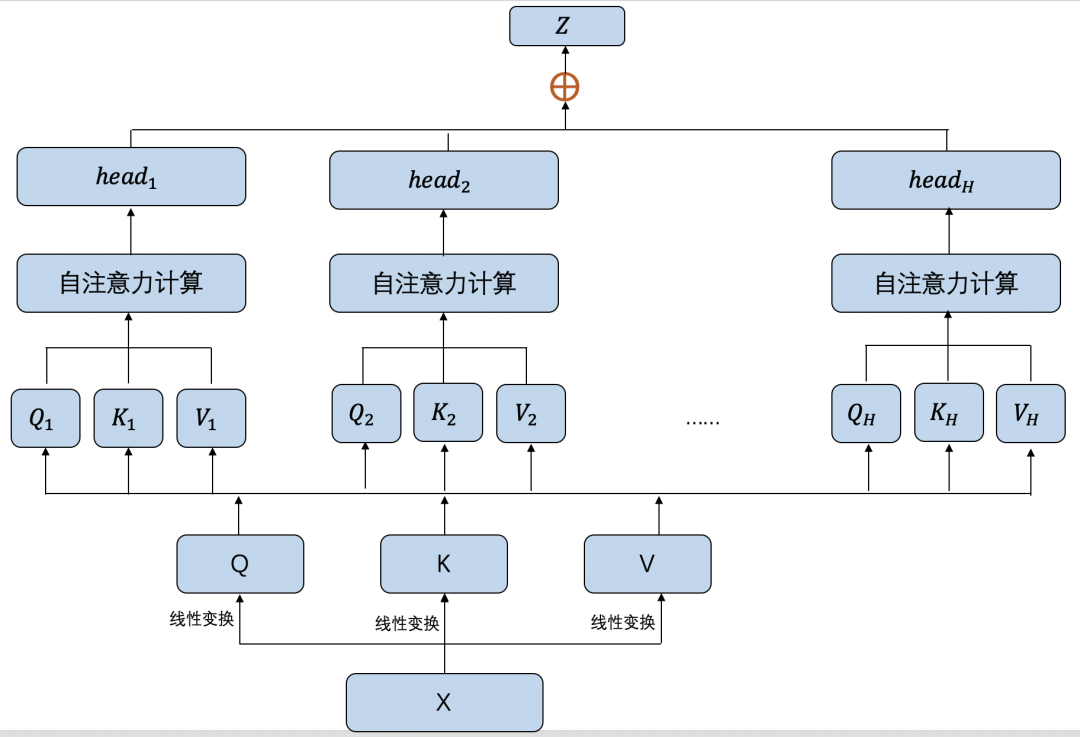

用讲故事的方式来解释 TransformerTransformer模型如何成为AI领域的'翻译官'?本文用生动比喻揭秘自注意力、多头机制等核心原理,带你读懂这个支撑GPT、BERT等大模型的技... ”——这叫自注意力。小T有一种超能力:他可以把每个词变成三种卡片:Q卡(查询卡):写着“我在找谁?”K卡(钥匙卡):写着“我是什么内容”V...

从零学习大模型(5)——位置编码:让 AI 读懂 “语序” 的关键技术含义完全相反。而 Transformer 的注意力机制是 “并行计算”(同时处理所有词),天然缺乏对语序的感知 —— 若没有位置编码,模型会把 “我打... 注意力分数的惩罚越大(符合人类阅读时 “近邻词关联更强” 的规律)。ALiBi 的优势在于极致简洁,无需修改嵌入向量或注意力计算,只需添加一...

政策提出加速人工智能终端产品创新,人工智能ETF科创(588760)早盘冲...消息面,9月29日,DeepSeek更新了一个实验性的人工智能(AI)模型,并称之为迈向新一代架构的中间步骤。DeekSeek在Hugging Face上发布帖子,概述了DeepSeek-V3.1-Exp平台,并解释说该平台引入一种名为DeepSeek Sparse Attention(DSA)的“稀疏注意力机制”,DSA可以在长上下文...

ˋ^ˊ 《轧戏》6位美女颜值排名,李婷婷第3,卢昱晓第2,第1气质很好很多争论其实绕开了关键。这部现偶最让人不适应的地方,不是剧情套路,也不是演员咖位,而是:一部开播前并不被看好的剧,怎么在并不占资源优势的情况下,把注意力一点点拽回来了?我想解释的,就是这个“反转”是怎么发生的,它背后靠的不是运气,而是一套可复盘的机制。 先把结果放...

?△?

飞飞加速器部分文章、数据、图片来自互联网,一切版权均归源网站或源作者所有。

如果侵犯了你的权益请来信告知删除。邮箱:xxxxxxx@qq.com

上一篇:注意力机制最简单解释

下一篇:免費加速器