注意力机制模型主要解决什么问题

*** 次数:1999998 已用完,请联系开发者***

╯▂╰ DeepSeek发布NSA AI模型:原生稀疏注意力机制实现降本增效与长...2025年2月18日,中国深度探索公司(DeepSeek)在人工智能领域放出大招——推出原生稀疏注意力(Native Sparse Attention,简称NSA)机制。这个技术专门解决传统AI模型处理长文本时计算量大、成本高的老问题,通过算法创新和硬件适配优化,让长文本训练和推理速度飞涨,同时还能保持...

阿里:Qwen3.5 Plus融合了线性注意力机制与稀疏混合专家模型阿里云百炼页面显示,Qwen3.5原生视觉语言系列Plus模型,基于混合架构设计,融合了线性注意力机制与稀疏混合专家模型,实现了更高的推理效率。在多项任务评测中,3.5系列均展现出与当前顶尖前沿模型相媲美的卓越性能,模型效果在纯文本与多模态方面相较3系列均实现飞跃式进步。

?^?

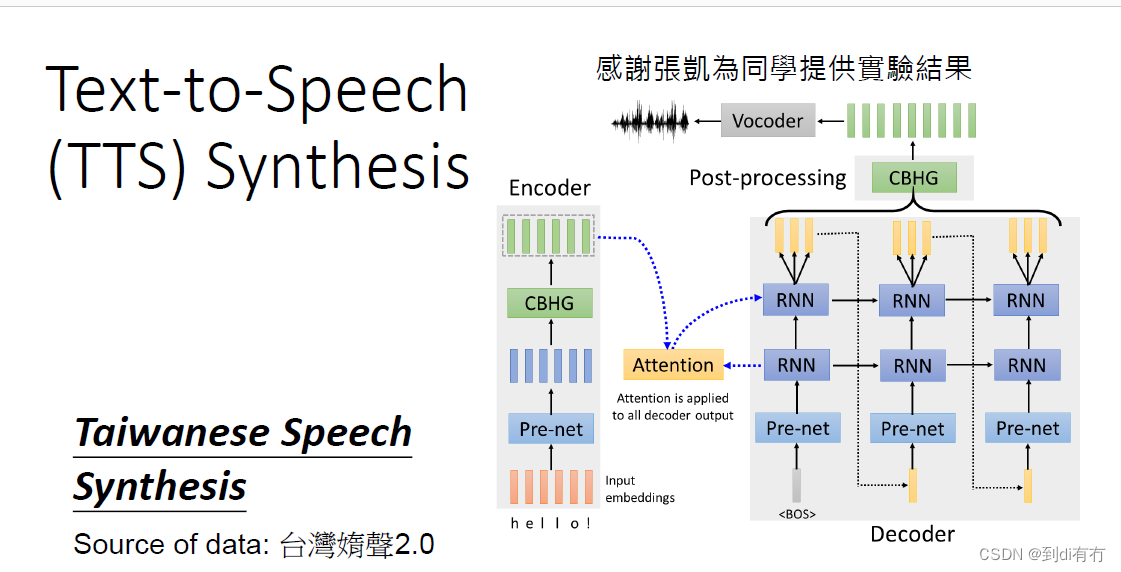

ˇ^ˇ FBK研究院:语音模型的"注意力"机制并非你想的那样可靠而大型模型则有8.78亿个参数,这些模型都采用了当前最先进的Conformer编码器架构。所有模型都是从头开始训练的,以避免数据污染问题,确保... Q&AQ1:交叉注意力机制在语音转文字中到底起什么作用?A:交叉注意力就像模型的"聚焦器",当模型生成每个文字时,它会回头查看输入语音的所...

o(╯□╰)o Kimi开源新线性注意力架构,首次超越全注意力模型,推理加速6倍用一种全新的注意力机制,在相同训练条件下首次超越了全注意力模型。在长上下文任务中,它不仅减少了75%的KV缓存需求,还实现了高达6倍... 模型越强,显卡越崩,钱包越痛。所以,过去几年无数团队都在研究线性注意力,希望把计算从 O(N²) 降到 O(N),让模型能又快又省。但问题是,以前...

(`▽′) DeepSeek携新版本回归 AI产业自主可控生态稳步形成南方财经4月25日电,4月24日,DeepSeek-V4预览版本正式上线并同步开源,这款搭载全新注意力机制的大模型,不仅能实现全球领先的长上下文处理能力,更以模型架构的创新突破,为中国AI产业开辟出一条“软硬协同,自主可控”的全新路径。在多位业内人士看来,这场由DeepSeek引发的...

DeepSeek V4正式发布,留下的5道主观题仍待解答还有基于MoE(混合专家模型)和稀疏注意力机制DSA,这些之前被外界猜测的参数和性能,随着官宣尘埃落定。 这次姗姗来迟,和V4把训练框架从... 而且和外界猜的“新模型支持多模态生成和理解”不一样,V4依旧是语言模型。暂缓多模态生成训练,主要是因为算力和现金吃紧。DeepSeek...

谷歌新架构融合Transformer与RNN,降低显存门槛解锁超长上下文现在的大模型基本都是用Transformer架构做的,它能成为主流,主要是因为记忆力能跟着上下文长度增长——注意力机制的计算量和空间占用会... 为了解决这个问题,研究圈又开始重新关注RNN、线性注意力模型(像LinearAttention)和状态空间模型(比如Mamba这些)。这些循环架构的好处是...

美团LongCat-Video视频生成模型发布:可输出5分钟长视频并宣称在开源模型中达到先进水平。据介绍,LongCat-Video可生成720p分辨率、30帧率的高清视频,其突出特点在于能够原生生成长达5分钟的连贯视频内容。模型通过视频续写预训练、块稀疏注意力等机制,旨在解决长视频生成中常见的画面断裂、质量下降等问题,保持时序一致性与运...

⊙ω⊙ 从零学习大模型(5)——位置编码:让 AI 读懂 “语序” 的关键技术在 Transformer 架构中,有一个容易被忽略却至关重要的模块 —— 位置编码(Positional Encoding,PE)。如果说注意力机制让模型能 “理解关联... 绝对位置编码存在共性问题,即外推能力弱 —— 当句子长度超过训练时的最大长度(如训练用 512 词,推理用 1024 词),新增位置(512-1023)的编...

国产芯片集体高潮!DeepSeek新模型发布当天,华为升腾代码直接开源9月29日,科技圈炸开了锅!DeepSeek突然甩出重磅炸弹——全新开源模型DeepSeek-V3.2-Exp横空出世。这款搭载了DSA稀疏注意力机制的大... 用“0day适配”证明了什么叫中国速度。寒武纪紧接着开源vLLM-MLU推理引擎,海光DCU平台也完成深度调优,16家国产芯片厂商7天内集体站...

飞飞加速器部分文章、数据、图片来自互联网,一切版权均归源网站或源作者所有。

如果侵犯了你的权益请来信告知删除。邮箱:xxxxxxx@qq.com

上一篇:注意力机制模型主要解决什么问题

下一篇:v2ray安卓版下载